Este texto ha sido traducido automáticamente desde la versión original en inglés.

Detection, Pose Estimation and Segmentation for Multiple Bodies: Closing the Virtuous Circle

ICCV 2025

SAM-pose2seg: Pose-Guided Human Instance Segmentation in Crowds

CVWW 2026

BBoxMaskPose v2:

Expanding Mutual Conditioning to 3D

Las cajas delimitadoras, los máscaras de instancia y las poses capturan aspectos complementarios del cuerpo humano; imponer su coherencia mutua resuelve las ambigüedades dominantes en escenas concurridas. El marco BBox–Mask–Pose conecta la detección, la estimación de pose y la segmentación en un bucle iterativo, donde cada predicción se usa para refinar las demás. ProbPose añade incertidumbre calibrada y modelado de visibilidad y presencia, estabilizando los puntos clave bajo oclusión y recorte. PMPose combina modelado probabilístico con condicionamiento por máscara, permitiendo una estimación top‑down robusta en interacciones densas. SAM-pose2seg especializa SAM para la segmentación humana guiada por la pose, simplificando el prompting y mejorando la calidad de las máscaras en multitudes. En conjunto, estos componentes forman BBoxMaskPose v2, ofreciendo mejoras claras en la separación de personas en interacción y estableciendo un nuevo estado del arte en COCO, OCHuman y en la estimación de pose 3D aguas abajo. Es el primer método con resultados por encima de 50 AP en OCHuman. Este trabajo muestra que el condicionamiento mutuo estructurado de modelos pequeños y específicos por tarea puede ser más efectivo que escalar grandes modelos fundacionales centrados en humanos.

Todos los componentes forman parte de la base de código de GitHub.

BBox-Mask-Pose

Bucle iterativo de detección, estimación de pose y segmentación de instancias, donde cada predicción está explícitamente condicionada por las demás. Al imponer coherencia entre representaciones, el bucle corrige errores progresivamente, separa personas en interacción y recupera instancias perdidas.

PMPose

Estimador top‑down 2D que combina condicionamiento por máscara con una representación probabilista de puntos clave, alcanzando el estado del arte entre métodos top‑down, especialmente en escenas concurridas.

SAM-pose2seg

Modelo de segmentación de instancias humanas guiado por pose que adapta SAM para segmentar personas a partir de puntos clave 2D. Alinear el prompting y el decodificador con señales de pose produce máscaras más limpias y estables en escenas concurridas.

Conjunto de datos OCHuman-Pose

Nuevos datos multi‑persona para escenarios de alta densidad. Extiende OCHuman con anotaciones de pose 2D para todas las personas visibles, incluidas instancias antes ignoradas. Permite una evaluación más precisa de detección y estimación de pose que el OCHuman original.

El conjunto de datos OCHuman-Pose está alojado en Hugging Face. Descarga los archivos desde el enlace de abajo.

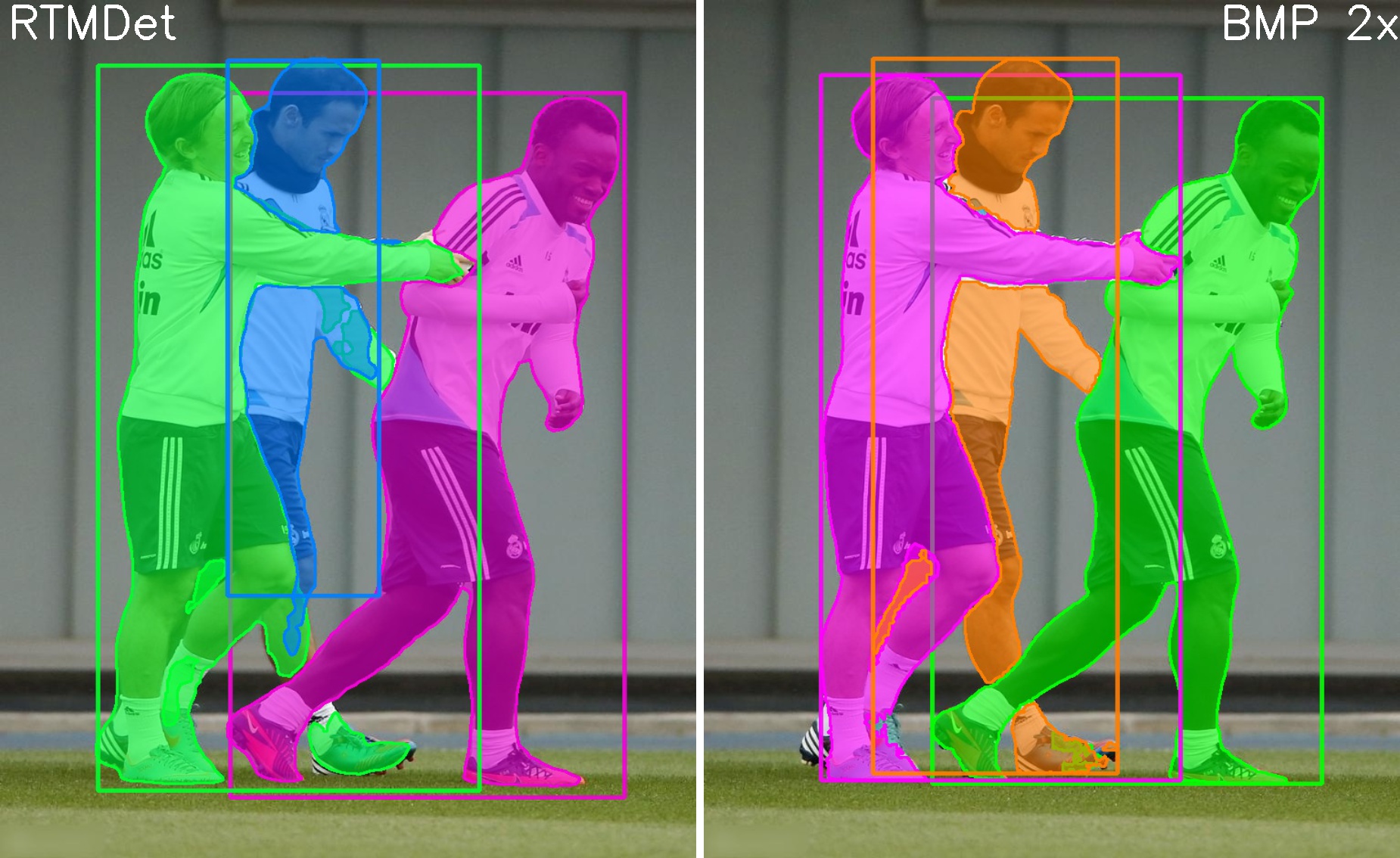

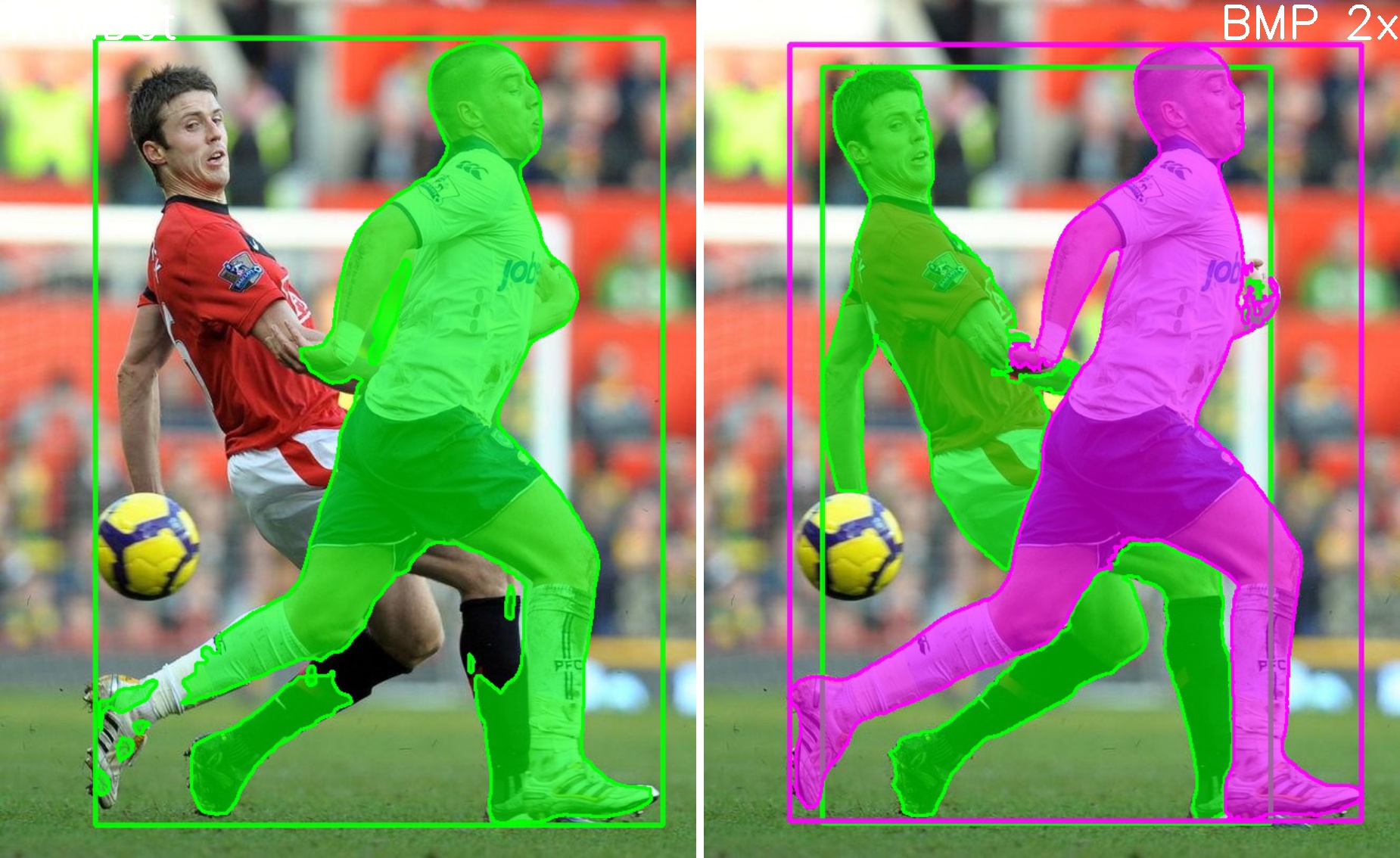

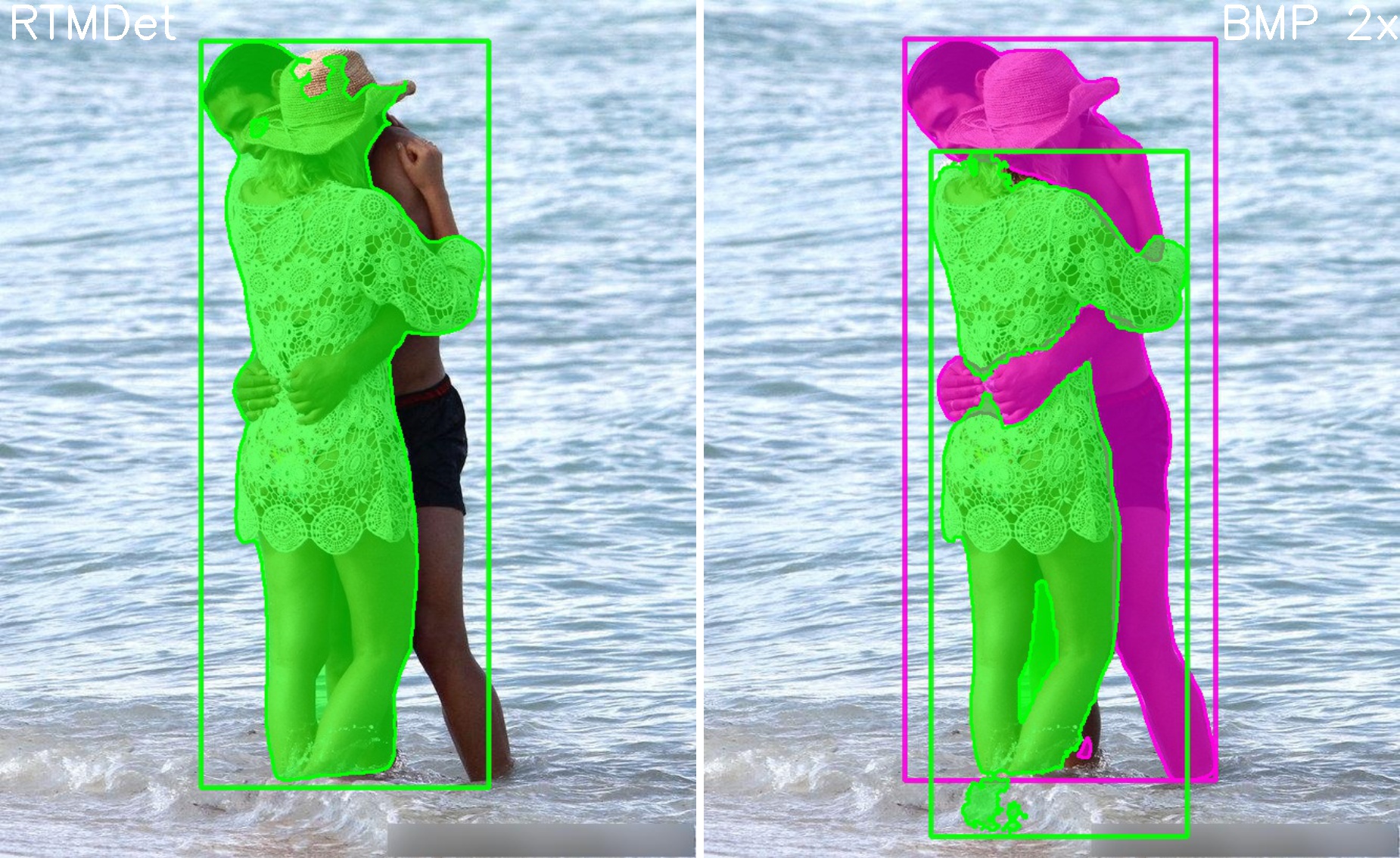

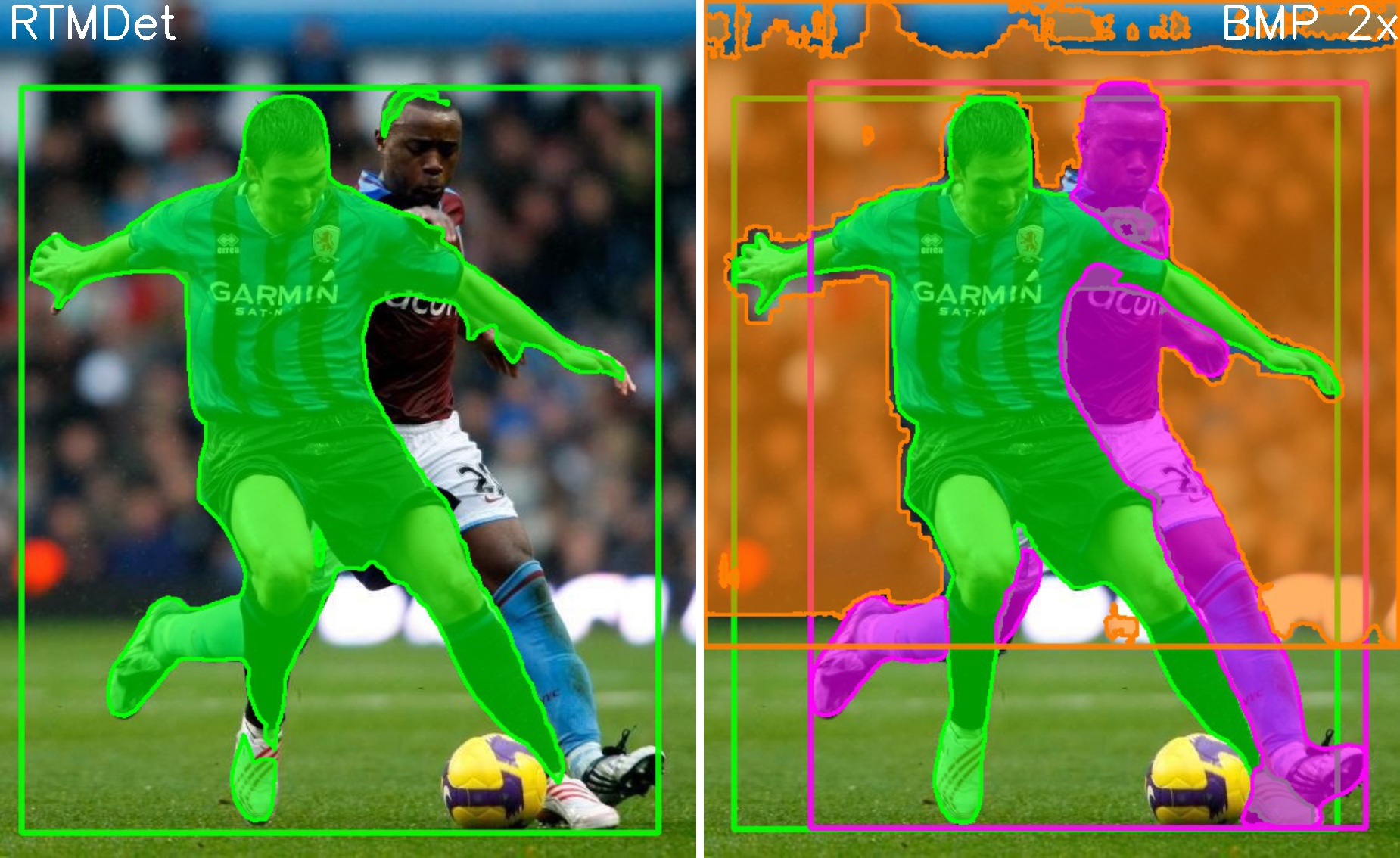

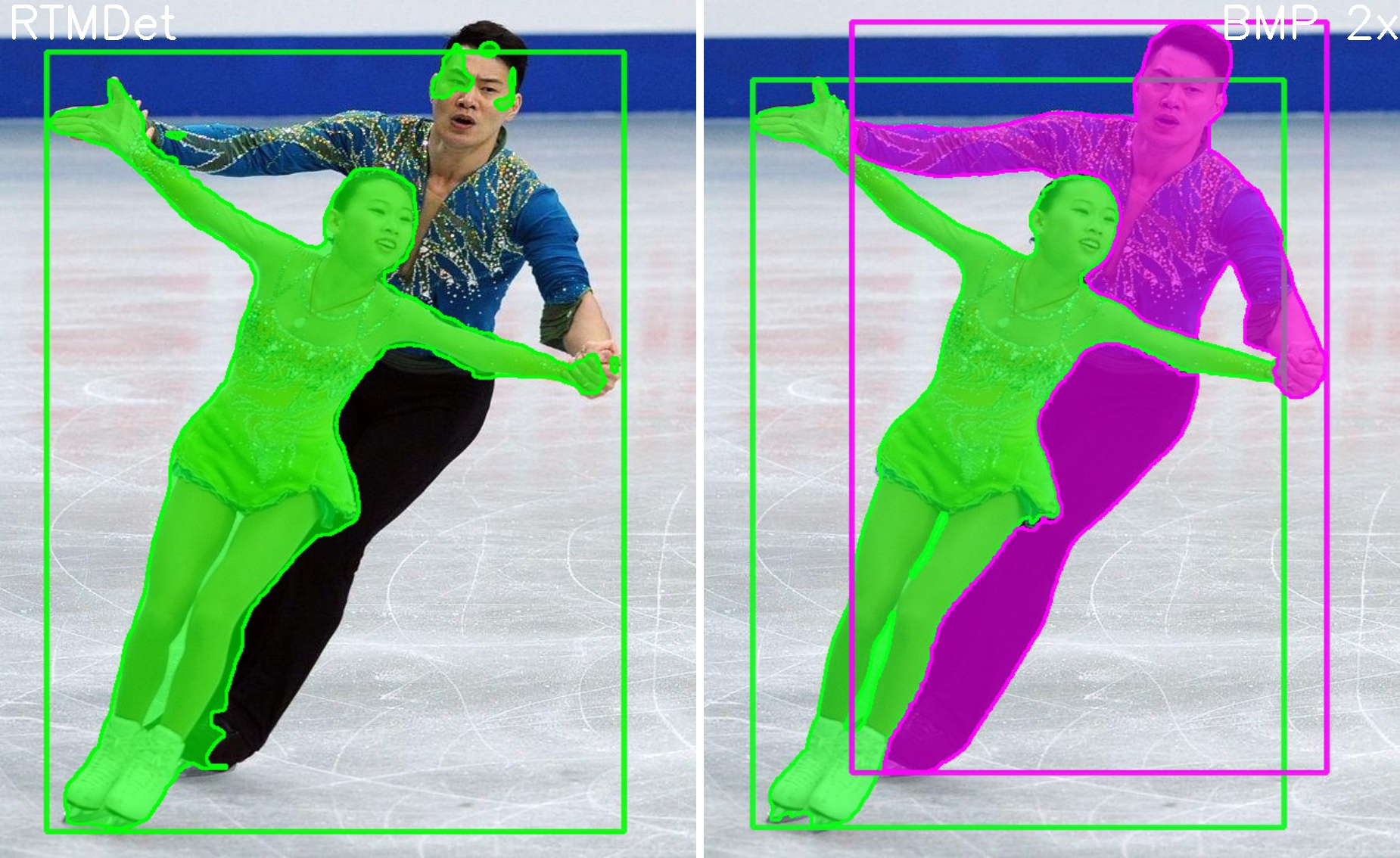

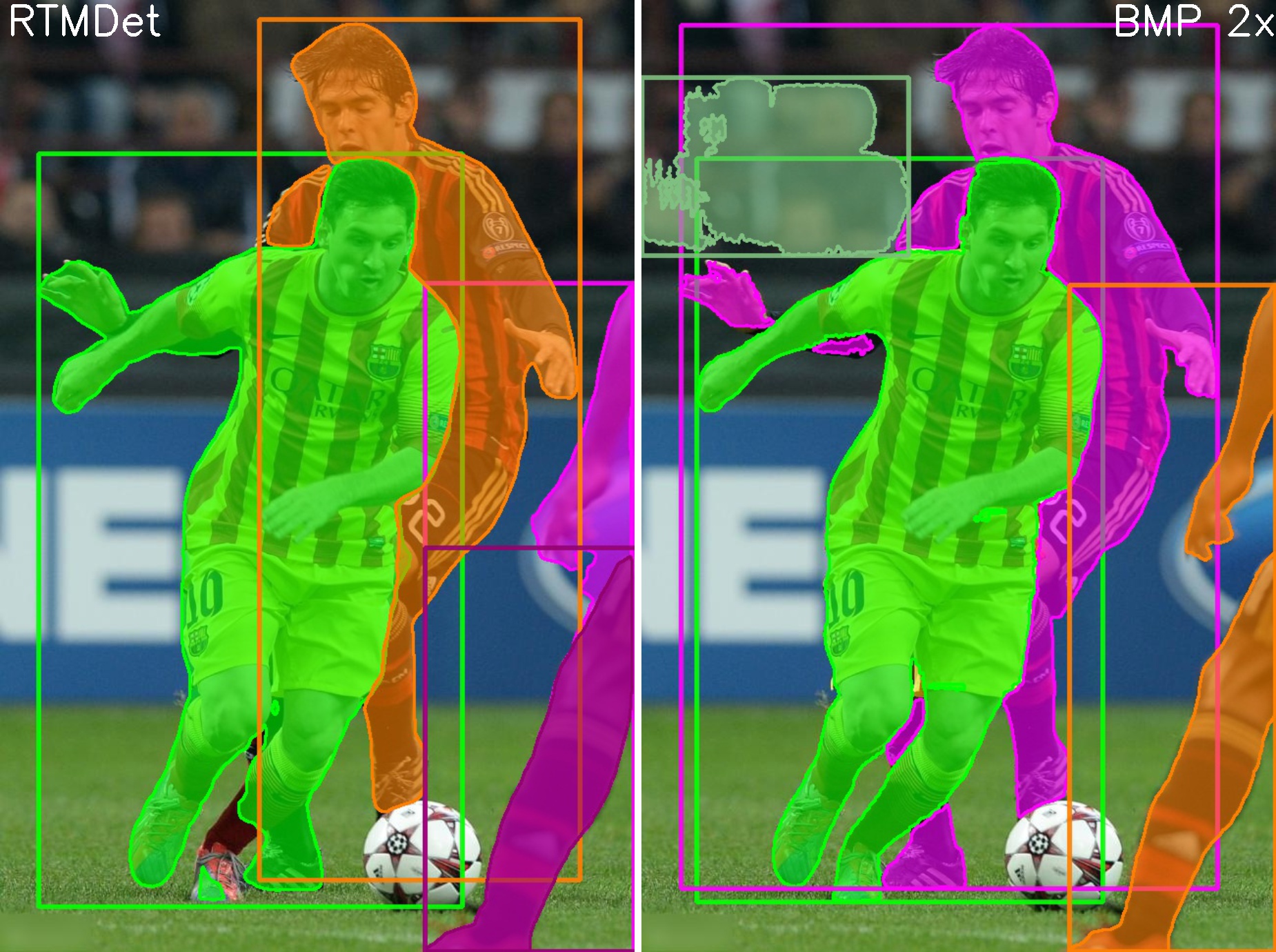

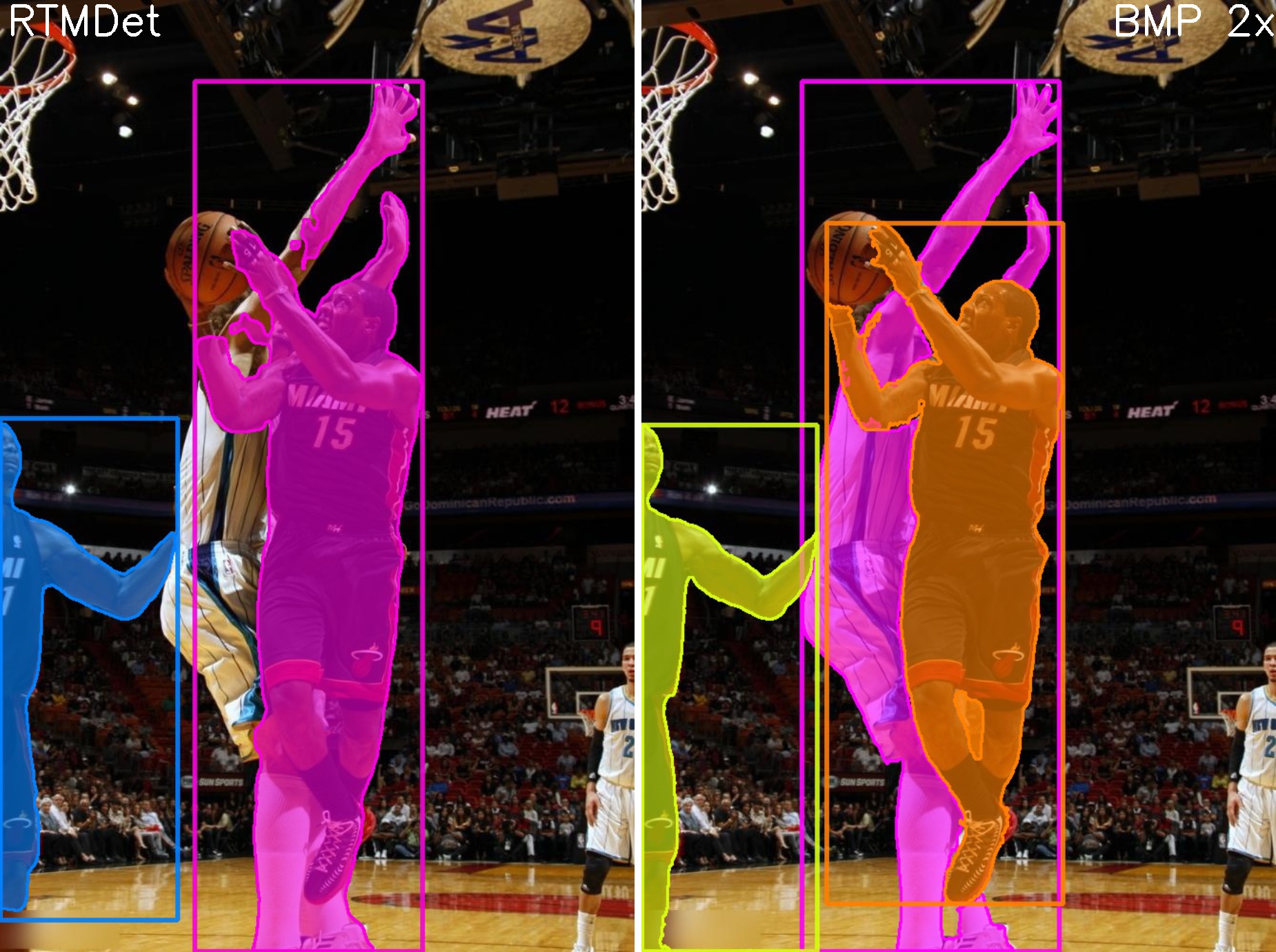

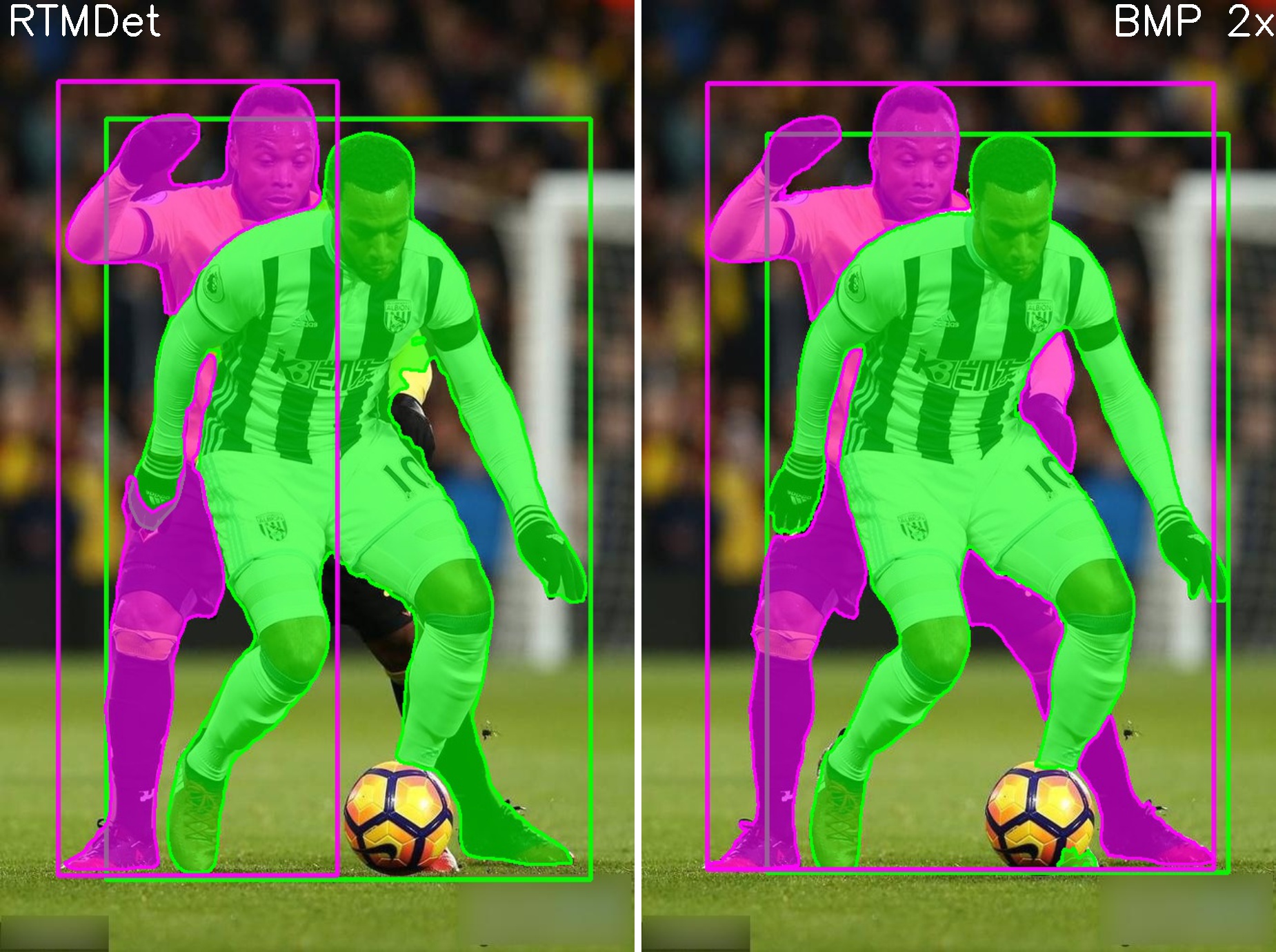

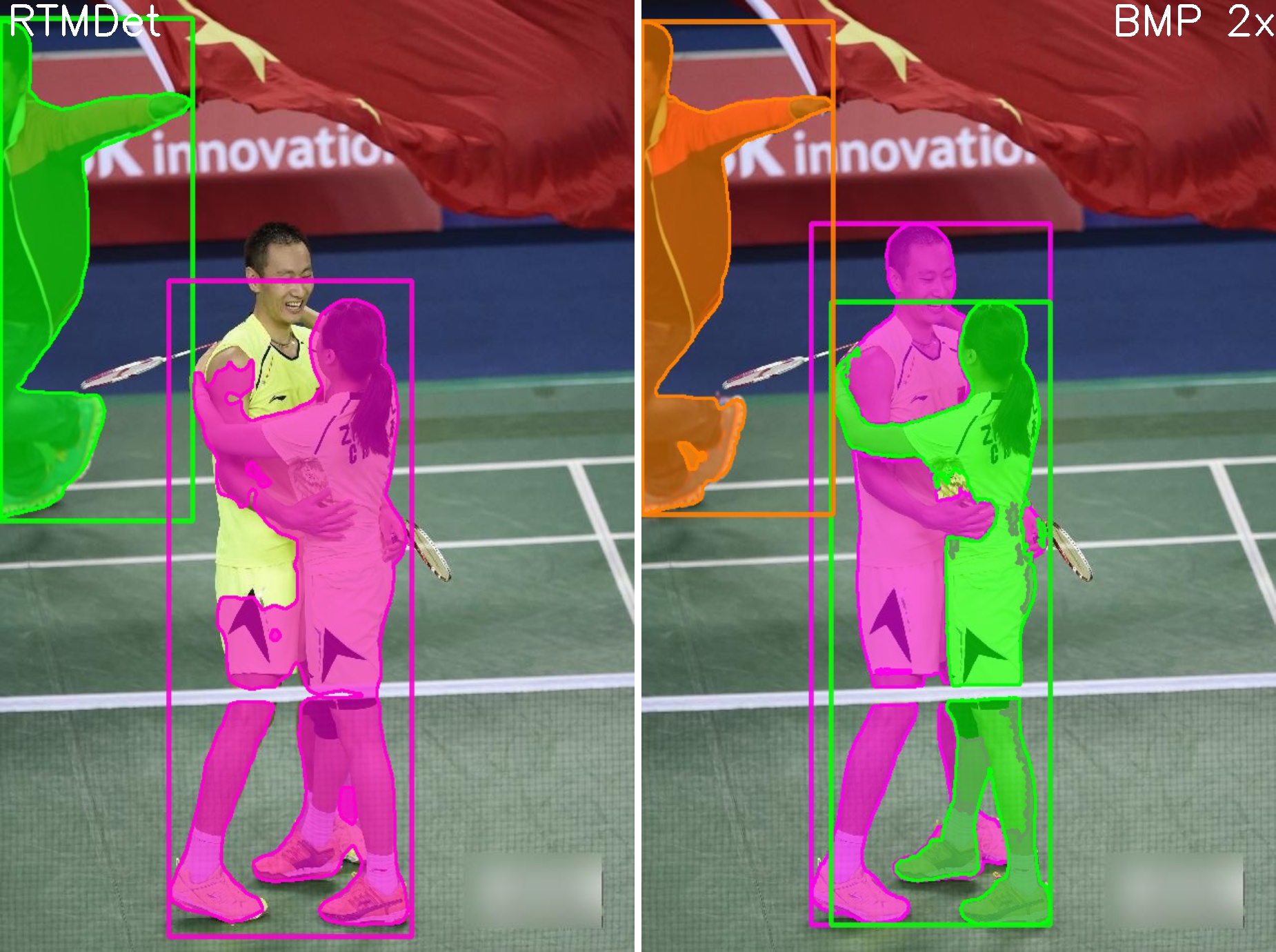

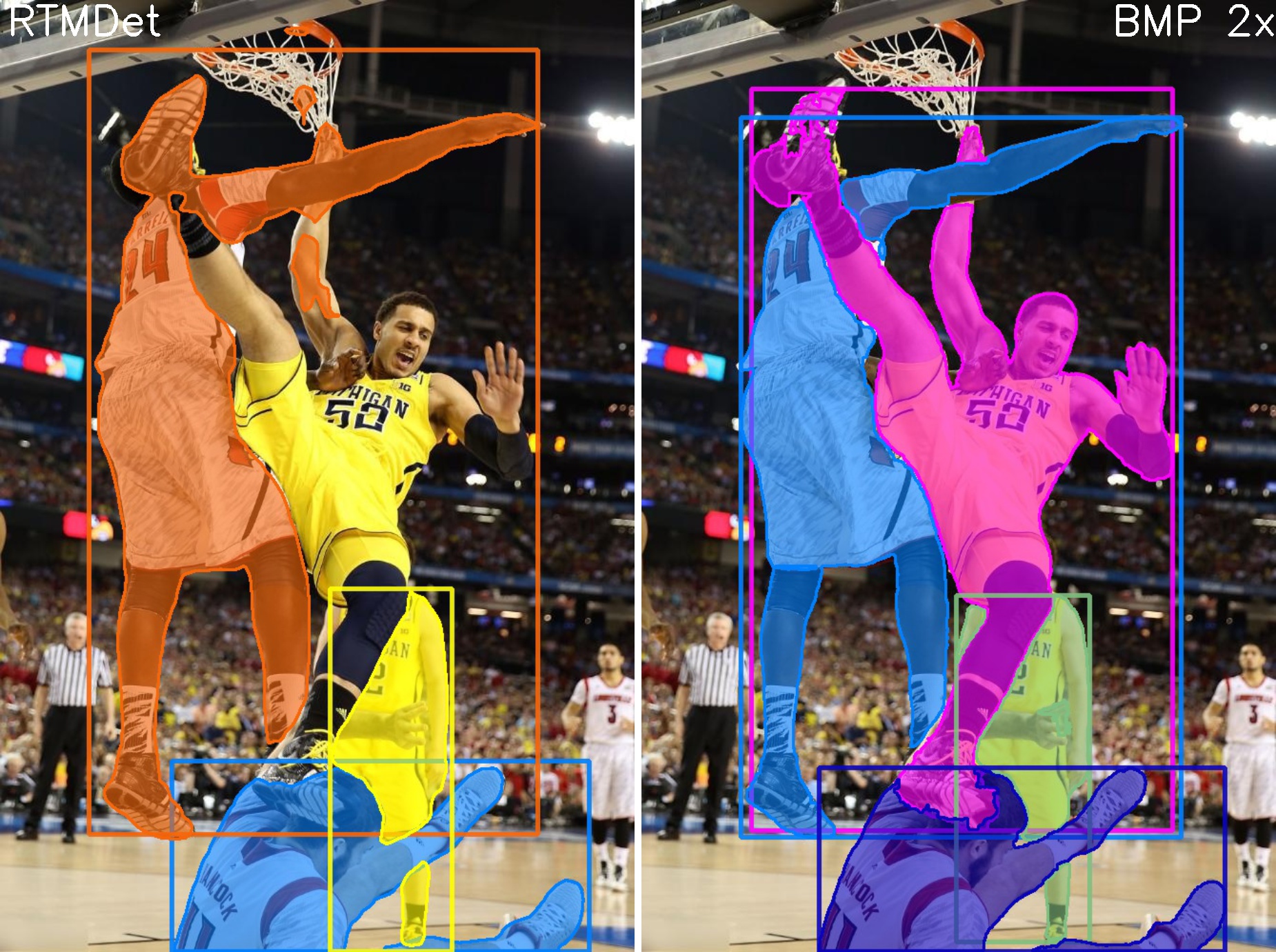

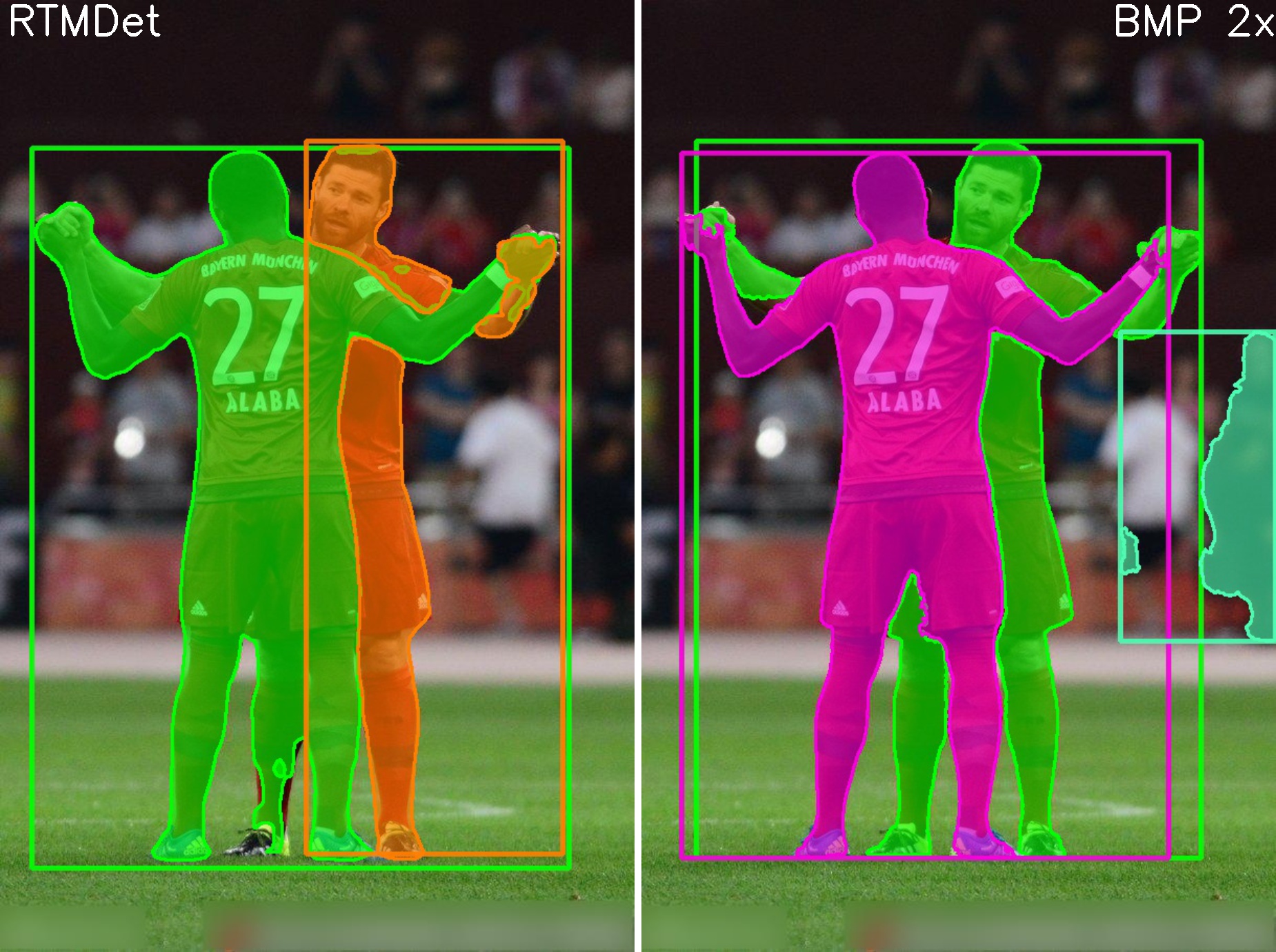

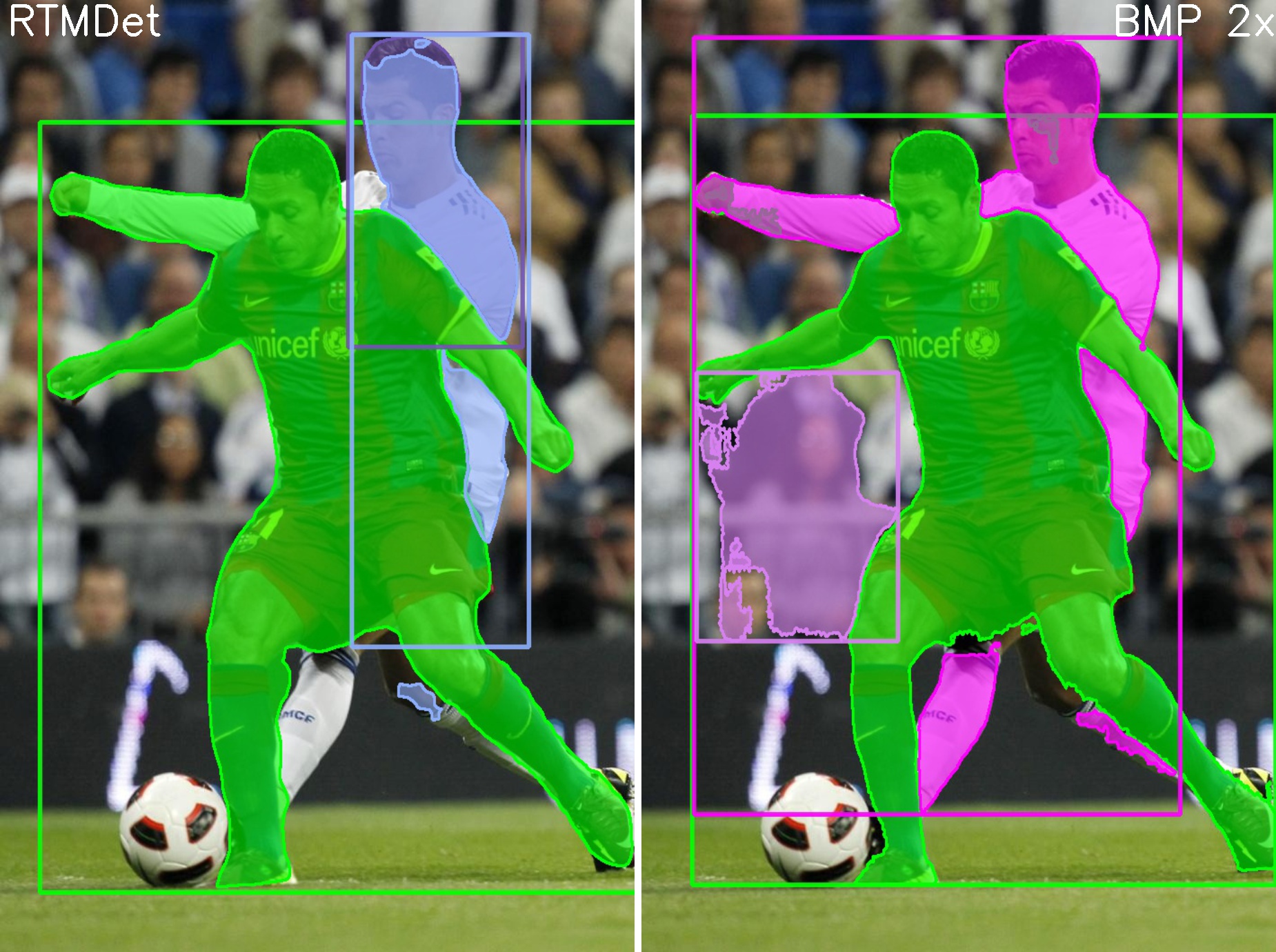

Comparación de la detección y segmentación de RTMDet (izquierda) y BBox-Mask-Pose (derecha). BMP mejora las máscaras de segmentación del detector dado, especialmente para partes corporales desconectadas como las extremidades. BBox-Mask-Pose también detecta el número correcto de personas incluso en escenas con solapamiento extremo de cajas delimitadoras.

@InProceedings{BMPv2,

author = {Purkrabek, Miroslav and Kolomiiets, Constantin and Matas, Jiri},

title = {BBoxMaskPose v2: Expanding Mutual Conditioning to 3D},

booktitle = {arXiv preprint arXiv:2601.15200},

year = {2026}

}

@InProceedings{Purkrabek2025ICCV,

author = {Purkrabek, Miroslav and Matas, Jiri},

title = {Detection, Pose Estimation and Segmentation for Multiple Bodies: Closing the Virtuous Circle},

booktitle = {Proceedings of the IEEE/CVF International Conference on Computer Vision (ICCV)},

month = {October},

year = {2025}

}

@InProceedings{Kolomiiets2026CVWW,

author = {Kolomiiets, Constantin and Purkrabek, Miroslav and Matas, Jiri},

title = {SAM-pose2seg: Pose-Guided Human Instance Segmentation in Crowds},

booktitle = {Computer Vision Winter Workshop (CVWW)},

year = {2026}

}